前回のエントリーに続き、ドローンを活用した視覚支援技術のお話です。

重度の視覚障害者がテーブル上の食器やドアノブなど特定の物体に触れようとした場合、大抵「手探り」で触れる対象物を探します。慣れた場所ならある程度、感覚で触れ当てることができますが、不慣れな状況では何かしらの手がかり、つまり情報が与えられなければあてもなく手探りを繰り返すことになります。目が見えていても真っ暗な部屋で照明のスイッチを探したり、洗髪中にコンディショナーを手探りした経験は誰にでもあるでしょう。一発で探し出すの、難しいですよね。

考えてみると、視覚を用いず特定の物体に素早く確実に触れるという動作は、結構難易度の高いミッションです。その一方、このような日常的なタスクを支援する手軽なソリューションは今のところほとんど存在しません。

ドイツ、パッサウ大学のFelix Huppert氏らの研究チームによる「GuideCopter - A Precise Drone-Based Haptic Guidance Interface for Blind or Visually Impaired People」は、2021年5月のCHI2021で発表された、視覚障害者の触察行動をドローンの誘導によって支援するというユニークな研究です(PDF)。

視覚障害者の触察をサポートする場合、対象物から誘導音を鳴らす、もしくは「もう少し右」といったように「音声」を用いて誘導する方法のほか、晴眼者が直接視覚障害者の手をとり、触れる物までエスコートするなどの手段が考えられます。

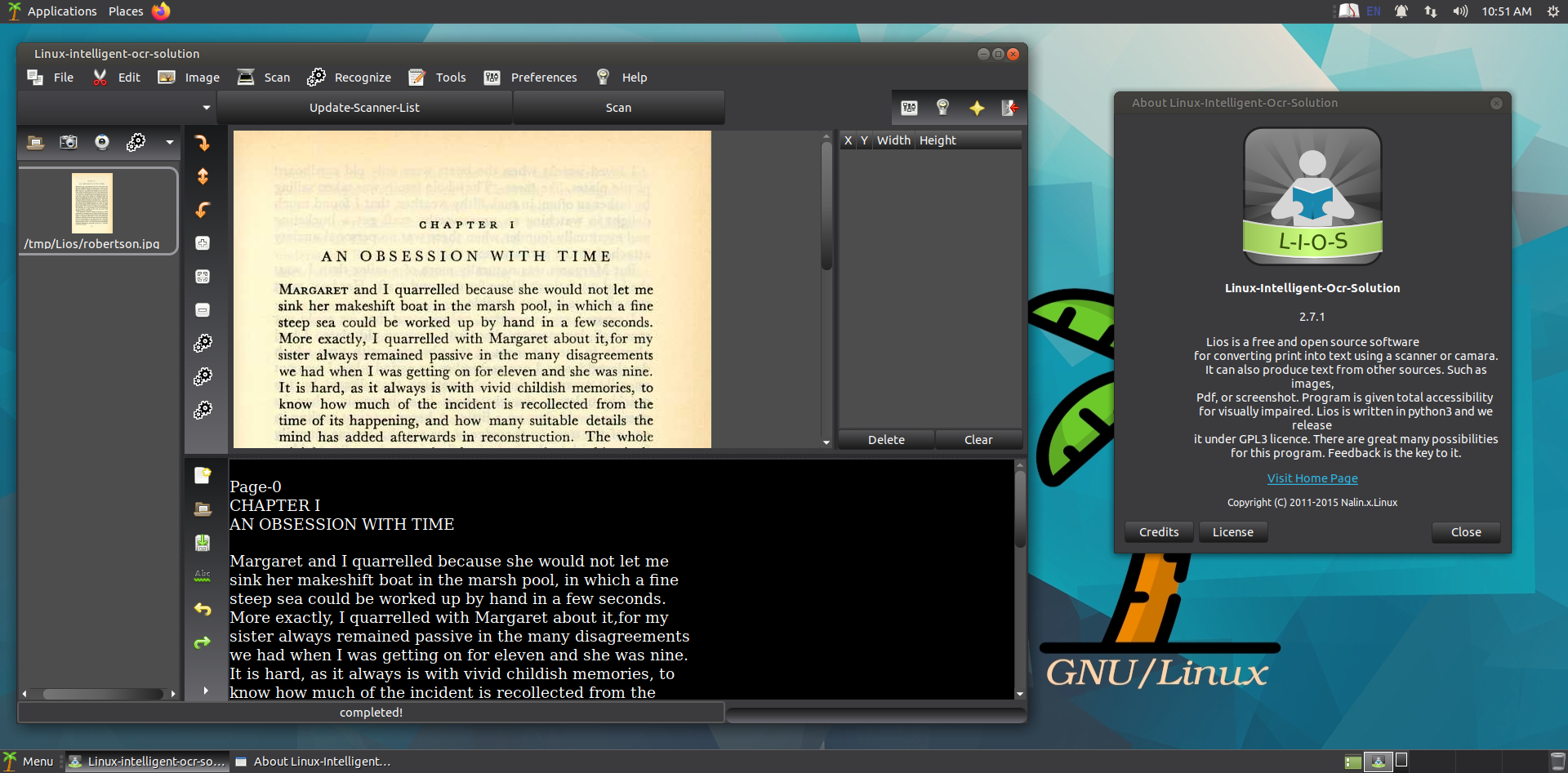

これまでにもこのような行動を支援する技術として、音声や振動フィードバックを用い視覚障害者を誘導するウェアラブルデバイス(指先装着型や手袋型など)が開発されてきました。しかしこのようなデバイスはユーザーの触覚を妨げたり習得に時間がかかるなど認知的負荷が高い欠点があると研究チームは語ります。

GuideCopterでは視覚障害者の感覚をできる限り損なわず、認知的負荷を軽減するため、ドローンによる誘導という手法を用いました。つまり触覚を妨げるデバイスを装着することなく、ドローンの引っ張る力で視覚障害者を導き、独立した触察行動を支援しようというわけです。

研究チームはさまざまな前実験を重ね、ドローンの動き方や引っ張る強さ、ドローンと手を接続するための最も効果的な方法を検討しました。

そして十分に引っ張る力を持った3インチのクアッドコプター(寸法20 cm ×5 cm)を独自に設計。このドローンを長さ50 cmの細いロープを用い、人差し指に装着したリングと接続しプロトタイプを制作しました。安全を確保するため、ドローンのプロペラには、カスタムメイドのプロテクターが取り付けられています。

10名の視覚障害者が参加した実証実験では、あらかじめ設定されたルートを飛行するGuideCopterが被検者の指を誘導し、物体を掴むまでの時間と正確さを計測。比較のため同じ物体を音声ガイダンスを用いて掴む実験も併せて行われました。

その結果GuideCopterは、音声による誘導システムと比べ、より早く、確実に目的の物体に触れることができ、認知的負担も少ないことがわかりました。

確かにユーザーはドローンの引っ張る力に身を任せてしまえば良いわけですから、音声を聞きつつ位置を調節するよりも直感的というか何も考えなくても使えるシステムであるといえます。この結果から、研究チームはドローンによる誘導システムが、視覚障害者の触察行動に一定の役割を果たセルのではと結論づけています。

もちろんこれはドローンによる誘導が視覚障害者の支援技術として有効であるかを検証するための基礎的な研究であり、すぐに実用化されるものではありません。しかし物体認識技術などと組み合わせることで、視覚障害者の触察行動のストレスを大きく軽減させる技術になるかもしれません。論文の中で研究チームは、小売店の商品を識別し、GuideCopterで欲しい品物を手に取るという応用例を提案しています。

視覚障害者をドローンが誘導するというアイデアはかなり以前から存在してはいましたが、手を引いて何かを触らせてくれるという、ある意味強引かつ大胆ともいえるGuideCopterの発想は個人的に新鮮でした。

これを実用化するためにはドローンの駆動時間や騒音、安全性といった多くの課題をクリアする必要があるでしょう。でも小型ドローンを使ったアイデアは考えるだけでも楽しそうです。

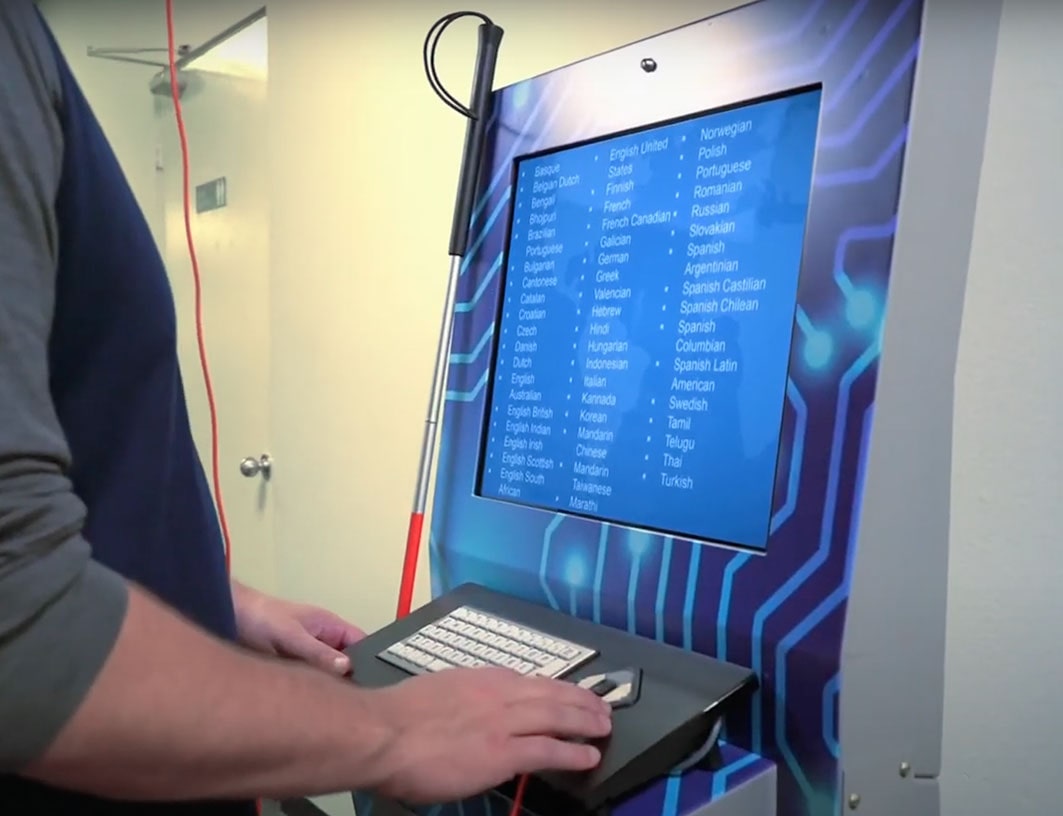

視覚障害者向け支援技術ではこれまで視覚的な情報を音声や触覚(振動)などに置き換える感覚置換(Sensory substitution)に基づいた技術が主流でした。しかし今後はドローンをはじめとするロボット技術との物理的というか運動的な相互作用の応用がアツいのかもしれません。今後どのような研究が出てくるのか、注目したいところです。